Business-Leaders

ChatGPT ist die große Revolution, so sagen alle. Die Medien berichten im Stundentakt darüber.

Doch was ist wirklich dran an dieser Hysterie?

Befürchtungen machen sich breit: Alle schreibenden Berufe werden arbeitslos. Journalisten, Texter und Songschreiber müssen sich einen neuen Beruf suchen?

Nein, dazu wird es nicht kommen. Und nein, auch Google wird daran nicht sterben.

KI und Chat-Bots werden die Zukunft verändern, das ist klar. Aber denken Sie daran, als die Fotografie im Jahre 1826 das Licht der Welt erblickte. Wurde danach die Malerei abgeschafft? Vincent van Gogh, Caspar David Friedrich, Claude Monet und Gustav Klimt lebten in dieser Zeit und waren auch nach der Erfindung der Fotografie weiterhin sehr gut beschäftigt.

Was ist ChatGPT?

ChatGPT (Generative Pre-trained Transformer) ist der Prototyp eines Chatbots, also eines textbasierten Dialogsystems als Benutzerschnittstelle, der auf künstlicher Intelligenz (KI) beruht. Den Texte erzeugenden vortrainierten Umformer entwickelte das US-amerikanische Unternehmen OpenAI, das ihn im November 2022 veröffentlichte. Um die Textgenerierung und das dahinter stehende Modell zu verbessern, wird die KI von ChatGPT durch menschliches Feedback ständig weiter trainiert.“

(Quelle: wikipedia, 20.01.2023, 9.45 Uhr)

ChatGPT verbreitet sich in den Uni’s und Schulen

Hausarbeiten von mehreren Seiten in Sekundenschnelle zu erledigen, das ist der Traum unserer Schüler und Studenten. Die perfekte Work-Life-Balance! Chillen und das Programm schreibt schnell mal eine Abhandlung über Neutronenforschung – das sind doch tolle Aussichten für Schüler und Studenten!

Wird sich das Chat-Bot in den Schulen und Universitäten durchsetzen und damit die Lehrkräfte überflüssig machen?

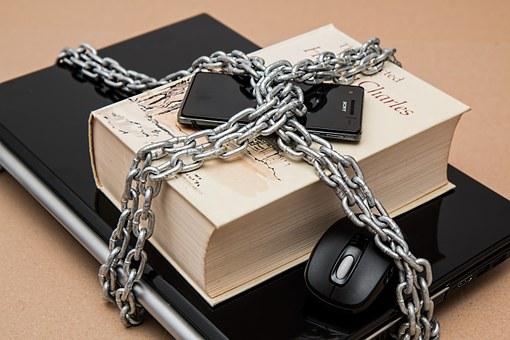

Erste Schulen und Universitäten in den USA haben in den Schulnetzwerken die Anwendung ChatGPT gesperrt, weil Schüler und Studenten schnell die Vorteile dieser Software erkannten … und natürlich auch nutzten. Aber dauerhaft können sich Schulen und Universitäten nicht dem Fortschritt in den Weg stellen und suchen nach einer vernünftigen Symbiose zwischen Lehrplan und ChatGPT.

Das Problem besteht nach Auskunft verschiedener Lehrervertreter darin, dass die Lernenden und Studierenden oft nicht verstanden haben, mit welchem Inhalt sich die -von KI geschriebene- Hausarbeit befasst. Wissenschaftliches Arbeiten für Studierende basiert nicht auf dem Auswendiglernen von Thesen, Daten und Tabellen, sondern auf Erfassen komplexer Zusammenhänge unter wissenschaftlichen Aspekten. So weit ist KI noch nicht und es bleibt zu bezweifeln, ob die Entwicklung so weit fortschreitet, dass das menschliche Gehirn ersetzt werden kann.

Als Alternative zu schriftlich (von KI) verfassten Hausarbeiten wollen die Lehrervertreter künftig mehr auf die Bewertung von mündlichen Leistungen setzen. Zudem berichten Lehrervertreter davon, dass sich schriftliche Hausarbeiten inhaltlich oft sehr ähnlich sind, wenn sie von ChatGPT verfasst wurden. Bisher gibt es noch keine gute Erkennungssoftware für KI-verfasste Texte, aber das bleibt nur eine Frage der Zeit.

Was sagt Google zu ChatGPT?

Verschiedene Medien behaupten, dass bei Google im Moment Code red angesagt sei. ChatGPT wäre der Google-Killer und die nächste Generation der Internetsuche.

Auf den ersten Blick ist das auch einleuchtend, beide Systeme geben Antworten auf Fragen, die man im Textfenster eingibt. ChatGPT erscheint hier komplexer und bequemer als Google, da man sich nicht durch mehrere Webseiten klicken muss, sondern eine zusammenhängende und inhaltsbezogene Antwort erhält. Gegen Chat GPT spricht, dass die Aktualität und Verlässlichkeit der Daten nicht gegeben ist. Dazu kommt die fehlende Transparenz der Datenquellen. Google ist hier eher konservativ eingestellt und setzt sich keinem unkalkulierbaren Image-Risiko aus, da die KI in diesem Bereich nach Google’s Auffassung noch nicht ausgereift ist.

Google selbst arbeitet seit vielen Jahren an dieser KI-Technologie. Projekte, wie PaLM, LaMDA und MUM sind mindestens so leistungsfähig wie ChatGPT. Teilweise setzt Google diese Software auch schon in verschiedenen Suchfunktionen ein.

Sollte sich ChatGPT etablieren, dann wäre die Geschäftsgrundlage von Google möglicher Weise gefährdet. Das Geschäftsmodell von Google ist der Verkauf von Werbung über die Inhalte der Suchmaschine. Wenn jetzt ChatGPT mit Microsoft (und deren Suchmaschine Bing) kooperiert, kann es durchaus sein, dass Google künftig einige Marktanteile an Bing abgeben muss. Aber Google wird das verkraften. Natürlich befindet sich ChatGPT noch in den Kinderschuhen bzw. in der Beta-Phase, deshalb ist es auch noch kostenlos zu haben.

Der Softwareriese Microsoft ist derzeit in Verhandlungen über eine Beteiligung bei Open AI. Microsoft will nach seiner ersten Investition in ChatGPT (aus dem Jahr 2019) von 1 Millarde jetzt weitere 10 Milliarden nachschießen und die Software in die eigene Suchmaschine Bing integrieren. Die Bewertung von ChatGPT würde dann bei etwa 29 Milliarden US-Dollar liegen. Im Vergleich, Google hat 2023 einen Marktwert von 458 Milliarden US Dollar, Microsoft liegt bei etwa 410 Milliarden US Dollar.

Auch Elon Musk ist bei ChatGPT sehr aktiv. Als Mitgründer von Open AI war er der innovative Kopf neben dem Hauptinvestor Microsoft. Er gründete Open AI 2015 zusammen mit dem Programmierer Sam Altman als gemeinnütziges Forschungsinstitut. 2019 firmierte Altmann das Projekt in ein Unternehmen um.

Eine Falle für Journalisten – Google stuft ChatGPT als Spam ein

Journalisten und alle Freunde der schreibenden Zunft denken jetzt vielleicht, dass ihr Arbeitsalltag mit Chat-GPT wesentlicher einfacher wird. Aber Vorsicht! Auch wenn es Google noch nicht offiziell bestätigt hat, existieren auf dem Markt schon Programme, die KI-Texte als maschinengeschriebenen Content identifizieren können.

Wer diese Art von Texten in eigenen Beiträgen bei Google verwendet, begibt sich auf sehr dünnes Eis. Er verstößt mit der Veröffentlichung eine KI-Beitrages gegen Google-Grundsätze.

Google prüft vor Veröffentlichung eines Textbeitrages, ob der Inhalt unique content (selbst verfasster, einmaliger Inhalt) oder einfach nur geklaut ist (oder zumindest teilweise Passagen ohne Quellenangaben „übernommen“ wurden). Gibt man einen KI-generierten Texten als seinen eigenen aus, so wird Google dies erfassen und die gesamte Seite entsprechend im Ranking abstufen. Das muss nicht zwingend heute und morgen passieren, aber mit der Entwicklung der KI wird auch die passende Scan-Software weiter entwickelt und bei Google zur Prüfung eingesetzt.

Mi Veröffentlichung KI-generierter Texte verletzt der „Autor“ unter Umständen auch Urheberrechte. Die Reaktion von Google ist dann klar: Nach dem DMCA (dem amerikanischen Urheberrecht) werden diese Inhalte als Spam behandelt, blockiert oder auch (unter Umständen) gelöscht. Die Seite wird runtergestuft und im Ranking behindert.

ChatGPT liefert Fake-Informationen

ChatGPT wird seit Jahren mit unzähligen Informtionen „gefüttert“. Inhalte mit etwa 500 Milliarden Wörtern in verschiedenen Sprachen wurden eingespeist, die Software für das Erfassen von Zusammenhängen wurde von Menschen trainiert. Die dazu verwendete Sprache lehnt sich an KI GPT-3, die Grundlage der Software basiert auf maschinellem Lernen, dem Deep Learning. Es sollen künstliche, neuronale Netze entstehen, die die Struktur des menschlichen Nervensystems nachbilden sollen. Die Verwendung der Sprache (Unterschied von mündlicher und schriftlicher Form) wird dieser Software nach und nach beigebracht.

Da die Künstliche Intelligenz (KI) nicht den Wahrheitsgehalt der aufgenommenen Informationen prüfen kann, ist das Ergebnis oft inhaltlich „verwaschen“. Sind zu einem Thema mehrere Informationen im Netz gespeichert, werden diese zusammengefasst und ausgewertet. Sind unter diesen Informationen Fake-News, dann ist das Ergebnis mit einem Teil Unwahrheit gefärbt. dazu kommt, dass die Informationen nicht aktuell sind.

Die KI arbeitetet mit der Vorhersage des wahrscheinlichsten nächsten Wortes in einem Satz, eine 1:1 Abfrage über den Wahrheitsgehalt erfolgt nicht.

Das Risiko der „stillen Post“ besteht hier akkut. Wird durch die Verbreitung von „Halbwahrheiten“ im Netz der Wahrheitsgehalt einer Aussage verzerrt, kommt es im Ernstfall dazu, dass die Summe der fake-news im Netz überwiegt und als gefühlte Wahrheit verbreitet wird. Im Ergebnis wird es oft nicht mehr möglich sein Wahrheit und Halbwahrheit zu differenzieren.

KI ist so gut wie ihr Programmierer

Auch Internetquellen, die populistische, rassistische oder sexistische Inhalte verbreiten konnten die Enwickler bei der „Fütterung“ von chatGPT nicht zu 100% filtern.

Die KI arbeitet während der Phase der Datenaufnahme eigenständig. Die Grundlage des Promramms ist GPT3, dieses wurde zu chatGPT modifiziert. Beide Programme basieren auf einem teilüberwachtem Training. In diesem Training werden der Software durch menschliche Eingaben bestimmte „Verhaltensweisen“ anerzogen bzw. abtrainiert. Die KI bekommt durch diese Art Training ein menschliches Gesicht.

Um die Verbreitung populistischer, rassistischer oder sexistischer Inhalte zu verhindern (oder wenigstens einzudämmen) wurden der KI chatGPT Schutzmechanismen eingebaut, die diese Inhalte filtern sollen. Ob dies dies in der Beta Phase schon immer gelingt, ist vage.

Weltweit wird schon seit vielen Jahren an Chatbots geforscht. Einige dieser Projekte mussten vom Netz genommen werden, weil die KI die Inhaltes des Internets und weiterer Datenquellen nicht filtern konnte. Die Ergebnisse dieser Programme waren teilweise populistisch, rassistisch, sexistisch und vulgär. Aus diesen Gründen überlebten die Chatbots „tay“ (Microsoft und „Lee Lunda“ (Lab, Südkorea) nicht die Beta Phase.

ChatGPT in der Beta Phase noch fehlerhaft

ChatGPT befindet sich derzeit noch in der Beta Phase. Im Zeitraum der Beta Phase ist ein Programm grundsätzlich schon nutzbar, ist aber noch nicht vollständig fehlerfrei. Bei der Nutzung kann es noch zu Bugs oder Programmabstürzen kommen. Erfahrungsgemäß wird ein Programm spätestens nach 1 Jahr Beta-Phase als Vollversion auf den Markt gebracht. Diese Versionen werden dann in aller Regel auch kostenpflichtig, im Gegensatz zur Beta Version.

So ist es auch nicht verwunderlich, dass die derzeit veröffentlichte Version von chatGPT noch inhaltliche Fehler liefert. Bei der Auswertung der Fragestellung durch den Benutzer gibt es für die KI verschiedene Möglichkeiten einer Anwort:

- Eine Antwort ist im Speicher hinterlegt. Es gibt nur 1 Antwort (z.B. Mathematik).

- Mehrere Antworten sind abgespeichert, die KI entscheidet sich für die „wahrscheinlichste“Antwort. Diese kann auch falsch sein, zumindest teilweise.

- Keine direkte Antwort befindet sich im „Gehirn“ der KI. Es wird die naheliegenste Antwort ausgeworfen. Diese kann der Wahrheit entsprechen, kann aber genau so gut völlig am Thema vorbeigehen.

- Es kommt nicht vor, dass die KI keine Antwort ausgibt. Hat ChatGPT keine direkte Antwort auf eine Frage im System gefunden, dann wird immer ein Näherungswert als Antwort verwendet.

Weiterhin ist die veröffentlichte Version von ChatGPT nicht auf dem aktuellen Stand der Informationen. OpenAI bestimmt im Januar 2023 seinen aktuellen Datenstand auf Dezember 2021. Neuere Informationen, wie Gaspreisbremse, kennt das Programm noch nicht. Die Frage danach wird trotzdem beantwortet, die Antwort darauf ist -na klar- frei erfunden und entbehrt jeder informellen Grundlage.

Expertenmeinung zu ChatGPT – Michael Keusgen, CEO Ella Media AG

Wir fragten Herrn Michael Keusgen, CEO der Ella Media AG nach seiner Meinung zum Thema Chat GPT:

„Wir sind natürlich immer an neuen Innovationen interessiert, aber wir sind der Zeit etwas voraus. Wir müssen nicht auf die Entwicklungen der chatGPT warten. Unsere eigens entwickelten KI Assistant Tools Re.write und Re.lease erstellen aus vorhandenen Texten automatisiert hochwertigen Content. Ob Nachrichten, Produktbeschreibungen, Marketingtexte, Infotexte bis hin zu Kurzgeschichten, jeder Text wird individuell innerhalb weniger Minuten generiert – unique und SEO-relevant. Die KI Writing Tools machen die Texterstellung und -verarbeitung einfacher, schneller und effizienter. Sie helfen so jedem Content Creator aus den verschiedenen Branchen, relevante und zuverlässige Texte und Inhalte in kürzester Zeit zu erstellen. Die sich aktuell in der Entwicklung befindenden Collaboration Tools, Co.script und Co.produce werden das kreative Schreiben unterstützen. Fantasien, Emotionen und Visionen der Autor:innen geben den Impuls für einzigartige Geschichten, die automatisiert generiert werden.“

ChatGPT und das Urheberrecht

Zunächst stellt sich die Frage, welches nationale Urheberrecht bei ChatGPT Anwendung findet. Meist wird das Schutzlandprinzip angewendet. Dieses besagt, es gilt das Recht des Landes, in dem der Inhalt das erste Mal veröffentlicht worden ist. Dabei ist zu beachten, dass in den USA der Urheberrechtsschutz auf den Schutz der ökonomischen Verwertbarkeit zielt. In Deutschland werden ideelle Werte, wie Texte oder Bilder, geschützt.

Zum Thema Urheberrecht für Produkte aus künstlicher Intelligenz gibt es in Deutschland heute durchaus verschiedene Rechtsauffassungen. Aus Mangel an menschlicher Schöpfung geht das Urhebergesetz in Deutschland ( § 2 Abs.2 UrhG) momentan davon aus, dass Werke, die von einer KI erzeugt werden, nicht urheberrechtlich geschützt sind. Einige Juristen gehen davon aus, dass KI-Werke unter urheberrechtlichen Schutz fallen, wenn der Einfluss eines Menschen so bestimmend ist, dass ihm das Ergebnis des Produktes noch zugerechnet werden kann. Dies wäre eher bei Bildern der Fall, wenn sie durch den Menschen nach der Erzeugung der KI aufwändig bearbeitet wurden.

Auf der Grundlage des „Gesetz über Urheberrecht und verwandte Schutzrechte“ muss man bei ChatGPT davon ausgehen, dass die Texte mangels Urheberrechtsschutz in rechtlicher Hinsicht beliebig -auch von Dritten- verwendet werden können. Die AGB’s von ChatGPT sehen allerdings vor, dass die von ChatGPT automatisch generierten Inhalte bei einer Veröffentlichung als solche gekennzeichnet werden müssen (Copyrights). Eine Verletzung des Copyrights setzt voraus, dass jemanden die Rechte, z.B. an geistigem Eigentum am Text oder Bildrechte zuzusprechen sind. Wenn jemand fremdes geistiges Eigentum ohne Zustimmung bzw. ohne Angabe der Quellenangabe verwendet, spricht man von einem Plagiat. Als KI hat Chat GPT kein geistiges Eigentum.

Die Daten, die ChatGPT für die Antworten verwendet, sind nicht auf Plagiate geprüft. Sollten also aus dem Datenbestand von ChatGPT Plagiate in Antworten einfließen, könnten die von ChatGPT erzeugten Antworten schlussendlich als Plagiate angesehen werden. Die Nachweisführung wäre hier schwer, zumal ChatGPT keine Quellen veröffentlicht.

Das Büro für Technikfolgen-Abschätzung im Deutschen Bundestag fordert zudem ein Kennzeichnungs-Label für automatisch mit KI erstellten Texten. Auch OpenAI erwägt, für die endgültige Version von chatGPT eine Art Wasserzeichen in die generierten Texte einzufügen.

Auf die Frage nach dem Urheberrechtes bei der Nutzung der Antworten von ChatGPT antwortete die KI von ChatGPT selbst folgendermaßen:

In der Regel sind Texte, die von einem Computerprogramm erstellt werden, automatisch durch das Urheberrecht geschützt. Das bedeutet, dass der Urheber des Programms, in diesem Fall OpenAI, das ausschließliche Recht hat, die Texte zu vervielfältigen, zu verbreiten und öffentlich darzustellen.

Es gibt jedoch einige Einschränkungen und Ausnahmen beim Urheberrecht für Computerprogramme. Eine davon ist die sogenannte „Schrankenregelung“: Wenn der Text, den ein Computerprogramm erstellt hat, lediglich ein Ergebnis einer automatischen Verarbeitung von Daten ist, die dem Programm übergeben wurden, und keine eigene schöpferische Leistung des Programms darstellt, dann kann er von jedermann verwendet werden, ohne dass hierfür die Erlaubnis des Urhebers eingeholt werden muss.

Es ist jedoch wichtig zu beachten, dass die Texte, die von ChatGPT erstellt werden, normalerweise nicht nur ein Ergebnis der Verarbeitung von Daten sind, sondern auch auf einer schöpferischen Leistung des Programms basieren. Daher ist es ratsam, die Erlaubnis von OpenAI einzuholen, bevor man Texte verwendet, die von ChatGPT erstellt wurden.

Auch es ist ratsam, die Nutzungsbedingungen und Datenschutzrichtlinien von OpenAI zu überprüfen, bevor man ChatGPT verwendet und Texte erstellt oder teilt, die das Ergebnis ihrer Arbeit sind.„

(Quelle: automatisch generierte Antwort von ChatGPT 20.01.23, 12.00 Uhr MEZ)

Abschlussarbeiten mit ChatGPT schreiben

Zugegeben, die Versuchung ist groß, wenn man als Schüler oder Student eine komplexe Hausarbeit zu einem Thema schreiben muss, welches einem nicht so liegt. Da kommt die künstliche Intelligenz mit der ChatGPT App gerade richtig. Doch auch hier lauern Gefahren und wenn man Pech hat, kommt eine ungenügende Prüfungsnote wegen „Betrugsversuch“ dazu.

Ähnlich, wie bei den Journalisten ist es bei schriftlichen Arbeiten an Schulen und Universitäten verboten, fremde Inhalte als sein eigenes geistiges Eigentum in Arbeiten auszugeben. Um dies zu regeln gibt es in Deutschland Gesetze, für diesen speziellen Fall gilt das Gesetz über Urheberrecht und verwandte Schutzrechte. Dieses Gesetz beschreibt die Go’s und no Go’s beim Verwenden fremden geistigen Eigentums. Schulen, Hochschulen und Universitäten haben außerdem Prüfungsordnungen, die zum Thema Urheberrecht eigene Regelungen haben.

Und liebe Schüler und Studenten, auch Lehrer und Prof’s sind oft cleverer, als Ihr denkt. Kommt eine Software zur Erkennung von KI generiertem Content auf den Markt, könnt Ihr sicher sein, dass Eure Pauker sich von ihrem üppigen Lehrergehalt diese Freude gönnen werden.

Und, bei wichtigen Abschlussarbeiten unterzeichnet Ihr mit Eurem Namen eine Eigenständigkeitserklärung bzw. eine Erklärung an Eides statt. Darin erklärt Ihr, dass…

Unterschied Eigenständigkeitserklärung vs. Versicherung an Eides statt

Eine Eigenständigkeitserklärung ist unter universitären Arbeiten üblich, eine Verletzung derselben ist aber nicht strafbewehrt. Wird bei einer wissenschaftlichen Arbeit mit Eigenständigkeitserklärung ein Verstoß erkannt, wird die Prüfung in der Regel als „nicht bestanden“ gewertet. Der Verstoß kann außerdem zur Exmatrikulation führen oder mit einem Verweis von der Universität geahndet werden. Nach den differenzierten Regelungen der Hochschulen können auch Geldbußen verhängt werden. Sollte ein Plagiat erst nach Verleihung des akademischen Grades ermittelt werden, führt dieser Verstoß zur Aberkennung des Grades.

Beispiel Eigenständigkeitserklärung

„Hiermit bestätige ich, xxxxxx, dass ich die vorliegende Arbeit selbstständig angefertigt und keine anderen, als die angegeben Quellen und Hilfsmittel benutzt habe, sowie wörtlich und sinngemäß übernommene Passagen aus anderen Werken kenntlich gemacht habe.“

Bei einer falschen „eidesstattlichen Versicherung“ bzw. „Versicherung an Eides statt“ betreten Sie den Bereich des Strafgesetzbuches. Bei falscher Versicherung an Eides Statt ist nach § 156 StGB der Straftatbestand erfüllt und kann geahndet werden. Das Strafmaß reicht von Geldstrafe bis zu einer Freiheitsstrafe bis zu 3 Jahren. Die eidesstattliche Versicherung findet sich meist unter Bachelor-, Master-, oder Doktorarbeiten.

Auch hier führt die spätere Erkennung eines Plagiats zur Aberkennung des akademischen Grades und zu einer Strafanzeige wegen falscher Versicherung an Eides statt (§ 156 StGB).

Beispiel einer Versicherung an Eides statt

„Eidesstattliche Erklärung

Hiermit erkläre ich, xxxxxxx, dass ich die vorliegende Arbeit eigenständig und ohne fremde Hilfe angefertigt habe. Textpassagen, die wörtlich oder dem Sinn nach auf Publikationen oder Vorträgen anderer Autoren beruhen, sind als solche kenntlich gemacht. Die Arbeit wurde bisher keiner anderen Prüfungsbehörde vorgelegt und auch noch nicht veröffentlicht.“

Plagiate kommen manchmal erst Jahre später ans Tageslicht

Zahlreiche (mehr oder weniger) prominente Mitbürger erwischt man immer mal wieder bei der Verletzung des Urheberrechts. Spätestens 2009, als Dr. Robert Habeck das Amt des Bundesvorsitzenden der Partei Bündnis 90/Die Grünen antrat, wurde seine Doktorarbeit von vielen interessierten Journalisten und Oppositionsvertretern mit der Lupe untersucht. Im Jahr 2000, als Habeck promovierte, gab es noch keine Software zum Finden geklauter Textstellen. 2009 aber kamen die ersten Entwicklungen von Plagiat-Software auf den Markt. Sie ist heute aus den Schulen und Universitäten unseres Landes nicht mehr wegzudenken. Seit Einführung dieser Software werden regelmäßig offizielle Arbeiten nach „nicht als Zitat gekennzeichnete Textstellen“ untersucht. Dies kann auch noch Jahre später erfolgen und hat schon einigen Politikern die Karriere gekostet.

Natürlich nutzen auch Suchmaschinen, wie z.B. Google, diese Funktion. Sie stellen dabei fest, ob der Inhalt von Beiträgen unique content ist oder ob sie eine Sammlung von past and copy vor sich haben. Beiträge und Seiten, bei denen „geliehener Inhalt“ gefunden wurde, werden von Google schlechter bewertet und im Ranking abgestuft.

Auch Autoren von Artikeln nutzen diese Suchfunktion, um Nutzer zu finden, die ihre Artikel ganz oder teilweise in ihre Webseiten einpflegen und nicht mit Quellenangaben versehen. Die logische Konsequenz ist meist die Abmahnung des Urheberschutz-Verletzers, verbunden mit einer Schadenersatzforderung und einer Unterlassungsaufforderung.

Bekannte Fälscher – Unsere Politiker machen es vor…

Bei Abschlussarbeiten, wie z.B. einer Doktor- oder Bachelorarbeit unterzeichnet der Autor am Ende der Arbeit eine Versicherung an Eides statt. Hierbei erklärt der Prüfling, dass er die Arbeit ohne fremde Hilfe angefertigt hat. Den Inhalt solcher Erklärungen haben manche Persönlichkeiten aus Wirtschaft und Politik zum Zeitpunkt Ihrer Doktorarbeiten nicht so ernst genommen und sind (meist viel, viel später) in die Falle getappt. In der Regel kostet so ein Betrug das geliebte offizielle Amt.

Hier ein paar prominente Beispiele:

| Autor | Funktion | Uni/Hochschule | Thema | Sanktion | Jahr |

| Franziska Giffey | Regierende Bürgermeisterin Berlin | FU Berlin | Europas Weg zum Bürger – Die Politik der Europäischen Kommission zur Beteiligung der Zivilgesellschaft. | Aberkennung Doktorgrad | 2021 |

| Karl Theodor zu Guttenberg | Bundesminister für Verteidigung 2009-2011 | Uni Bayreuth | Verfassung und Verfassungsvertrag. Konstitutionelle Entwicklungsstufen in den USA und der EU | Aberkennung Doktorgrad | 2011 |

| Anette Schavan | Bundesministerin für Bildung und Forschung 2005-2013 | Heinrich Heine Uni Düsseldorf | Person und Gewissen: Studien zu Voraussetzungen, Notwendigkeit und Erfordernissen heutiger Gewissensbildung. | Aberkennung Doktorgrad | 2013 |